Siamo agli ultimi giorni di marzo 2026 e il mondo dell’intelligenza artificiale non smette di sorprendere. Se pensavo che la model avalanche di metà mese avesse esaurito le cartucce, mi sbagliavo di grosso: nell’ultima settimana sono emersi leak clamorosi, chiusure inaspettate e milestone infrastrutturali che ridisegnano il panorama AI con cui chiudiamo il primo trimestre dell’anno.

In questo articolo vi racconto le notizie più significative dal 24 al 30 marzo 2026, quelle che nella mia esperienza di system administrator e sviluppatore AI hanno un impatto concreto sul modo in cui lavoriamo con questi strumenti ogni giorno. Dalla fuga di documenti su Claude Mythos alla chiusura improvvisa di Sora, passando per il traguardo storico del Model Context Protocol e un benchmark che ha messo in ginocchio tutti i frontier model.

Se vi siete persi le novità della settimana precedente, vi consiglio di recuperare il mio articolo sulle novità AI della quarta settimana di marzo, perché il contesto aiuta a capire la velocità con cui si muove tutto.

Claude Mythos: Il Leak che Ha Scosso l’Industria AI

Il 26 marzo 2026 Fortune ha pubblicato uno scoop che ha fatto tremare l’intero settore: ricercatori di sicurezza hanno scoperto quasi 3.000 documenti non pubblicati in un database Anthropic non protetto e pubblicamente accessibile. Tra questi, bozze di blog post che descrivono un nuovo modello chiamato Claude Mythos, internamente noto anche come Capybara.

Quello che emerge dai documenti è impressionante. Mythos non è un semplice aggiornamento: rappresenta un nuovo tier di modello, superiore alla famiglia Opus che fino ad oggi era la più potente di Anthropic. Le bozze leaked indicano che Mythos ottiene “punteggi drammaticamente più alti” rispetto a Claude Opus 4.6 nei test di software coding, ragionamento accademico e — il punto più controverso — cybersecurity.

Da sysadmin, la parte che mi preoccupa di più è questa: Anthropic sta privatamente avvisando alti funzionari governativi che il modello rende gli attacchi informatici su larga scala “molto più probabili nel 2026”, perché consente ad agenti AI di operare autonomamente con sofisticazione e precisione sufficienti a penetrare sistemi aziendali, governativi e municipali. Se lavorate nella sicurezza difensiva con AI agents, questo è il momento di alzare il livello di guardia.

La strategia di rilascio prevede un lancio graduale: prima un gruppo ristretto di clienti early-access focalizzati sulla cybersecurity, poi espansione tramite API. Anthropic stessa ammette nelle bozze che il modello è “molto costoso da servire” e stanno lavorando per renderlo più efficiente prima di qualsiasi rilascio generale. Contestualmente, si parla di un possibile IPO di Anthropic già dal Q4 2026, con una potenziale raccolta superiore ai 60 miliardi di dollari — la seconda IPO più grande della storia dopo SpaceX.

OpenAI Chiude Sora: Fine di un’Epoca per il Video AI

Il 24 marzo 2026 è arrivata la notizia che pochi si aspettavano: OpenAI chiude Sora, la sua app di generazione video. L’app cesserà di funzionare il 26 aprile 2026, mentre l’API verrà spenta il 24 settembre 2026.

I numeri raccontano una storia di ambizione scontratasi con la realtà economica. Dopo un lancio in grande stile, gli utenti attivi mondiali di Sora avevano raggiunto il picco intorno al milione per poi crollare sotto i 500.000, mentre l’app bruciava circa un milione di dollari al giorno in costi di inferenza. Sam Altman ha preso la decisione di terminare Sora, liberare compute e riorientare le risorse.

L’aspetto più controverso? Disney aveva impegnato 1 miliardo di dollari nella partnership con Sora, ma ha scoperto della chiusura meno di un’ora prima dell’annuncio pubblico. L’accordo è morto con l’app. Il modello Sora 2 rimane accessibile tramite ChatGPT per gli abbonati a pagamento, ma l’ecosistema standalone — app dedicata, piattaforma social e API per sviluppatori — viene eliminato.

Questa chiusura è un campanello d’allarme per chiunque costruisca servizi basati su API di terze parti. Come ho scritto analizzando i costi delle API AI a marzo 2026, la sostenibilità economica dell’inferenza è il vero collo di bottiglia di questa industria, e Sora ne è la dimostrazione più eclatante.

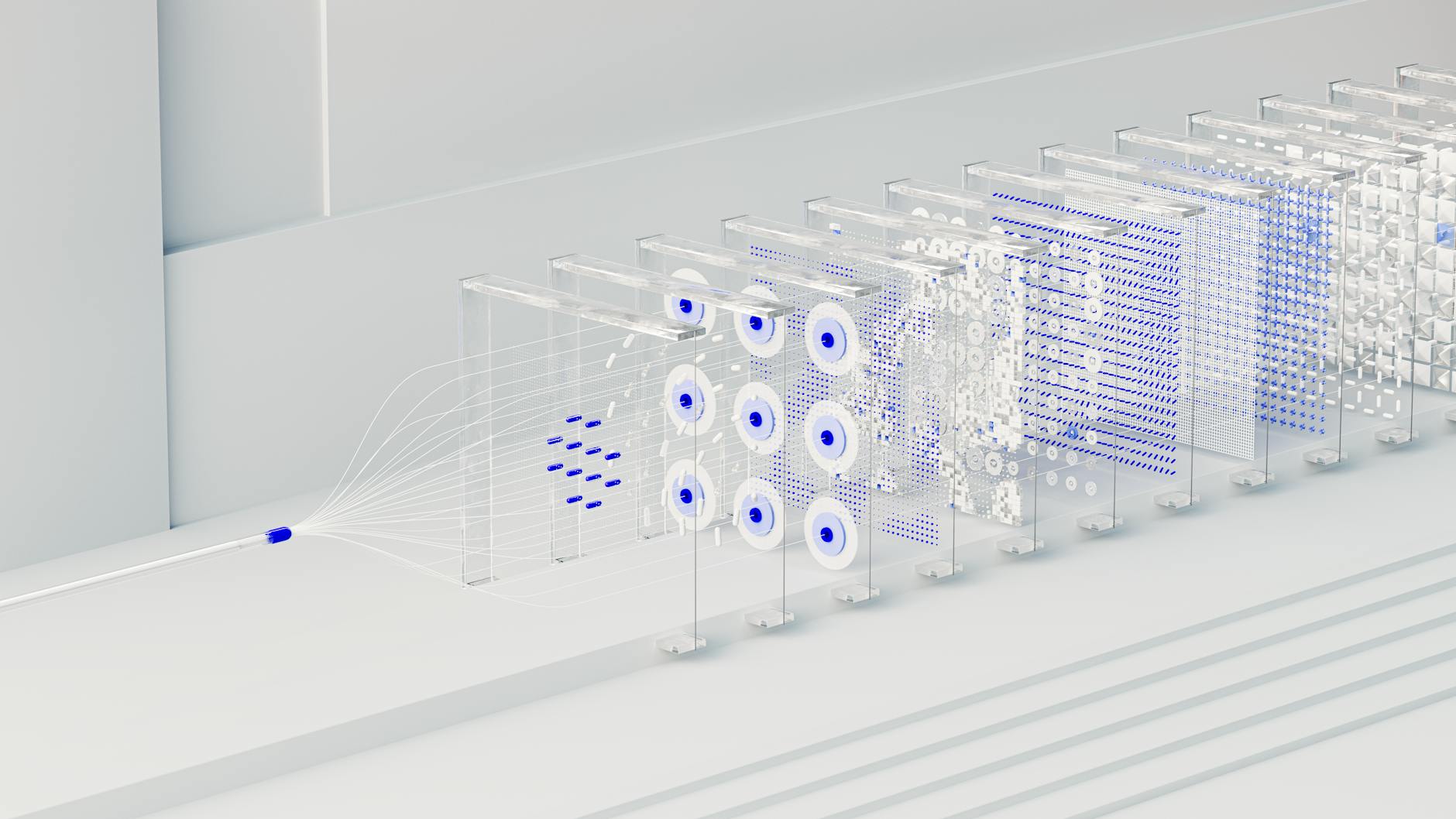

MCP Supera i 97 Milioni di Installazioni: da Protocollo Sperimentale a Standard de Facto

Il 25 marzo 2026 il Model Context Protocol di Anthropic ha superato i 97 milioni di installazioni mensili dell’SDK, segnando la curva di adozione più rapida per qualsiasi standard infrastrutturale AI nella storia. Per mettere il dato in prospettiva: Kubernetes ha impiegato quasi quattro anni per raggiungere una densità di deployment comparabile negli ambienti enterprise.

Da circa 2 milioni di installazioni al lancio nel novembre 2024, MCP è cresciuto del 4.750% in 16 mesi. Il dato più significativo è che ogni major AI provider — OpenAI, Google DeepMind, Cohere, Mistral — ora include il supporto MCP nei propri framework per agenti come impostazione predefinita. L’ecosistema di server MCP è cresciuto a oltre 5.800 server comunitari ed enterprise che coprono database, CRM, cloud provider, strumenti di produttività e piattaforme e-commerce.

Se avete letto il mio articolo su come uso l’estensione MCP Server di Plesk, sapete che nella mia esperienza quotidiana MCP ha trasformato il modo in cui gestisco i server. Il fatto che a dicembre 2025 Anthropic abbia donato MCP alla Agentic AI Foundation sotto la Linux Foundation, rendendolo uno standard vendor-neutral e community-governed, è stato il punto di svolta che ha accelerato l’adozione enterprise.

ARC-AGI-3: Il Benchmark che Ha Umiliato Tutti i Frontier Model

Mentre i lab AI continuano a vantare punteggi record sui benchmark tradizionali, l’ultima settimana di marzo ha portato una doccia fredda: il rilascio di ARC-AGI-3, il nuovo benchmark progettato per testare il ragionamento generale astratto.

I risultati sono stati impietosi. Ogni singolo frontier model ha ottenuto meno dell’1% su task che il 100% degli esseri umani ha risolto al primo tentativo. Il miglior modello è stato Gemini 3.1 Pro con uno 0,37%. Per capirci: questi non sono problemi di matematica avanzata o coding complesso, ma test di ragionamento spaziale e pattern recognition che qualsiasi persona risolve senza sforzo.

Questo risultato è un promemoria importante per chi lavora con l’AI ogni giorno. I modelli che usiamo per generare codice, analizzare log e automatizzare task sono strumenti potentissimi, ma il ragionamento generale — quello che i ricercatori chiamano fluid intelligence — rimane un problema aperto. Chi parla di AGI imminente dovrebbe guardare questi numeri con attenzione.

Il Movimento #QuitGPT e la Frattura Etica nell’AI

Una delle storie più significative di marzo 2026 è la frattura etica che si è aperta nell’industria AI attorno ai contratti militari. Dopo che OpenAI ha firmato un accordo per deployare i propri modelli sulle reti classificate del Pentagono il 28 febbraio, il movimento #QuitGPT ha raggiunto oltre 2,5 milioni di adesioni, con un crollo del 295% nelle disinstallazioni di ChatGPT.

La storia ha avuto risvolti inaspettati: oltre 30 dipendenti di OpenAI e Google DeepMind hanno firmato una dichiarazione a sostegno della causa legale di Anthropic contro il Dipartimento della Difesa, dopo che il Pentagono aveva etichettato Anthropic come “rischio per la supply chain” — una designazione solitamente riservata ad avversari stranieri — perché l’azienda si era rifiutata di permettere l’uso dei propri modelli per sorveglianza di massa o per l’attivazione autonoma di armi.

Lo scontro tra i CEO è stato pubblico e duro: Dario Amodei di Anthropic ha definito l’approccio di OpenAI “safety theater”, mentre Sam Altman ha ammesso su X che il rollout era stato “sloppy” (sciatto). Nel frattempo, Claude ha superato ChatGPT nel ranking delle app gratuite sull’App Store USA per la prima volta, con un aumento dei download del 51% nel weekend successivo alla firma del contratto.

Per chi come me sviluppa framework di governance per AI agentica, questa vicenda sottolinea quanto la fiducia degli utenti e le scelte etiche siano diventate fattori competitivi reali, non solo marketing.

Mistral Small 4: L’Open Source che Sfida i Modelli Chiusi

Il 16 marzo Mistral AI ha rilasciato Mistral Small 4, un modello Mixture-of-Experts da 119 miliardi di parametri totali (ma solo 6-8 miliardi attivi per token) sotto licenza Apache 2.0. Il modello unifica instruction following, ragionamento, comprensione multimodale e coding agentico in un singolo deployment.

I punti chiave per chi valuta l’integrazione in produzione:

- Architettura MoE: 128 esperti, 4 attivi per token — efficienza computazionale eccezionale

- Contesto da 256K token per analisi di documenti lunghi

- Ragionamento configurabile: toggle tra risposte rapide a bassa latenza e output di ragionamento profondo

- Multimodalità: accetta input testo e immagini

- Performance: 40% di latenza in meno e 3x throughput rispetto a Mistral Small 3

Disponibile su Hugging Face, Mistral API e container NVIDIA NIM, con supporto per vLLM e llama.cpp. Come ho analizzato nel mio articolo sui modelli AI open source nel 2026, questa release conferma il trend: i modelli open source MoE efficienti stanno erodendo il vantaggio dei modelli chiusi molto più grandi.

Apple Apre Siri a Tutti gli AI Provider

Ultimo colpo di scena di fine marzo: Apple ha annunciato che con iOS 27 Siri verrà aperta a tutti i provider AI tramite un nuovo sistema di Extensions. Gemini, Claude e altri potranno competere direttamente all’interno dell’iPhone. Parallelamente, Apple sta sviluppando un chatbot interno (nome in codice Campos) alimentato da Gemini di Google.

Questa mossa cambia le regole del gioco per la distribuzione dei modelli AI. Con oltre un miliardo di dispositivi iOS attivi, l’accesso diretto a Siri significa raggiungere utenti che non avrebbero mai scaricato un’app AI dedicata. Come avevo scritto riguardo alla partnership Apple-Google per Siri, il Private Cloud Compute di Apple rimane il differenziatore chiave sulla privacy.

Cosa Significa Tutto Questo per il Q2 2026

Chiudendo il primo trimestre 2026, tre tendenze emergono con forza:

- La corsa ai modelli è insostenibile: Sora chiude perché costa troppo, Mythos sarà “molto costoso” anche per Anthropic. I costi di inferenza sono il vero bottleneck.

- L’infrastruttura agentica è matura: MCP a 97 milioni, MoE efficienti come Mistral Small 4 e il focus su Computer Use di Anthropic indicano che il Q2 sarà dominato dai workflow autonomi, non dai chatbot.

- L’etica è un vantaggio competitivo: #QuitGPT ha dimostrato che le scelte sui contratti militari hanno conseguenze commerciali immediate. La fiducia si perde in un giorno e si ricostruisce in anni.

Per chi gestisce infrastrutture e sviluppa soluzioni AI come faccio io, il messaggio è chiaro: serve puntare su standard aperti (MCP), modelli efficienti (MoE) e governance trasparente. Il Q2 2026 sarà il trimestre in cui l’AI smette di essere hype e diventa ingegneria.

FAQ

Cos’è Claude Mythos e quando sarà disponibile?

Claude Mythos (nome in codice Capybara) è il nuovo modello di Anthropic superiore alla famiglia Opus, emerso da un leak di documenti il 26 marzo 2026. Attualmente è in fase di test con clienti early-access focalizzati sulla cybersecurity. Non esiste ancora una data di rilascio pubblica — Anthropic sta lavorando per renderlo più efficiente prima di un lancio generale, date le sue elevate esigenze computazionali.

Perché OpenAI ha chiuso Sora?

OpenAI ha chiuso Sora perché l’app bruciava circa un milione di dollari al giorno in costi di inferenza con meno di 500.000 utenti attivi. La generazione video su larga scala si è rivelata economicamente insostenibile. L’app chiuderà il 26 aprile 2026, mentre l’API resterà attiva fino al 24 settembre 2026. Il modello Sora 2 rimane accessibile solo tramite ChatGPT per abbonati.

Cosa significa il traguardo dei 97 milioni di installazioni per MCP?

Il Model Context Protocol ha raggiunto la massa critica come standard infrastrutturale per gli agenti AI. Con 97 milioni di installazioni mensili dell’SDK, ogni major provider (OpenAI, Google, Mistral, Cohere) lo supporta nativamente. Per sviluppatori e sysadmin, questo significa che investire nell’ecosistema MCP è una scommessa sicura per l’interoperabilità dei propri workflow agentic.

Perché ARC-AGI-3 è importante se tutti i modelli hanno fallito?

ARC-AGI-3 dimostra che i frontier model eccellono in task specifici (coding, matematica, analisi testi) ma falliscono nel ragionamento generale astratto che qualsiasi essere umano risolve facilmente. Questo benchmark ridimensiona le affermazioni sull’AGI imminente e ricorda che i modelli attuali sono strumenti potenti ma fondamentalmente diversi dall’intelligenza umana.

Il movimento #QuitGPT ha avuto un impatto reale su OpenAI?

Sì, l’impatto è stato misurabile: oltre 2,5 milioni di adesioni, un crollo del 295% nelle disinstallazioni di ChatGPT e il sorpasso di Claude nelle classifiche App Store USA. OpenAI ha dovuto rivedere il contratto con il Pentagono aggiungendo salvaguardie contro la sorveglianza domestica. Sam Altman ha pubblicamente ammesso che il rollout era stato gestito male.